Как парсить твиттер на python

Извлечение твитов из Twitter с помощью API с Python

Здравствуйте, читатели, в этой статье я буду представлять вас в API Twitter а именно Tweepy, который используется для извлечения твитов с помощью Python. надеюсь вам понравится

Извлечение твитов из Twitter с помощью API с Python

Здравствуйте, читатели, в этой статье я буду представлять вас в API Twitter а именно Tweepy, который используется для извлечения твитов с помощью Python. Я надеюсь, что вам понравится читать эту статью.

Требования к извлечению твитов из Twitter с помощью Python

Давайте перейдем на то, что нам нужно, чтобы начать здесь.

1. Учетная запись Developer Twitter

Чтобы получить доступ к Tweepy API, вам важно создать учетную запись разработчика, и эта учетная запись должна быть одобрена из Twitter. Так любезно убедитесь, что вы предоставили правильные детали и правильную причину использовать Tweepy.

Вот как вы можете создать учетную запись разработчика.

2. Программное обеспечение для съемки

Вам понадобится программное обеспечение, которое может читать распределительный лист, такой как Microsoft Excel или LibreOffice Reader.

Код для извлечения твитов из Twitter

В этом примере кодирования мы выделим данные из Twitter.com, используя Tweepy.

1. Импорт необходимых библиотек и настроить токены OAUTH

Так что начать с, импортируйте необходимые библиотеки, такие как Tweepy и Pandas, а также объявляют токен ОАУТ, который получен во время создания вашего приложения на приборной панели Twitter Developer.

2. Авторизуйтесь с Tweepy’s Oauthhandler

Теперь, когда мы определили ключи, мы приступим к разрешению самим собой с Tweepy’s Oauthhandler. Мы пройдем ключи, как показано ниже.

Теперь мы передам эти детали авторизации в Tweepey, как показано ниже.

3. Извлечение конкретных твитов из Twitter

Вы можете определить переменную по имени search_words и укажите слово, о котором вы хотели бы получить твиты.

Tweepy проверяет все твиты для этого конкретного ключевого слова и извлекает содержимое. Это может быть хэштеги, @ доменные или даже нормальные слова.

Иногда даже ретветы являются экстрактами и избежать того, чтобы мы фильтровали ретветы.

Теперь для каждого твита в Tweepy Cursor мы ищем слова и передаем его, как показано ниже. Затем мы пишем содержимое в файл CSV, как показано после кодировки UTF-8.

4. Вытащивание метаданных твитов

В приведенном ниже фрагменте кода я хочу получить только время создания Tweet, текста Tweet, имя пользователя и местоположение.

Теперь мы откроем файл CSV в режиме Append и запись содержимого из Twitter в этот файл.

5. Полный код для извлечения твитов из Twitter с помощью Python и Tweepy

Весь код выглядит как показано ниже. Вы можете выполнить это и найти файл CSV со всеми вами нужными данными в одном рабочем каталоге, что и ваш файл Python.

Выход вышеуказанного кода представляет собой файл CSV, который выглядит следующим образом:

Пожалуйста, обратите внимание, вывод будет варьироваться в зависимости от ключевых слов поиска.

Заключение

Таким образом, мы пришли к концу этой статьи и попытались извлечь некоторую информацию из Tweepey. Надеюсь, тебе нравится делать это! Дайте нам знать ваши отзывы в разделе комментариев ниже.

Парсинг твитов пользователя

Хочу распарсить все твиты, но выводятся только 18 из 1152.

1 ответ 1

Однако если необходим именно парсинг, то вот:

Обычный HTML парсинг не вытянет вам содержимое спрятанное за JavaScript’ом. Здесь нужен кардинально другой подход. Что-бы полноценно работать с JavaScript’ом, и получать итоги его преобразований вам нужно работать не через Суп и urllib, а через браузер. Сколько бы вы не «крутили» страницу вниз, твиты не добавятся, так как они прилетают по JavaScript’у.

У меня аналогичная ситуация решается связкой Selenium+PhantomJS. Это управляющий драйвер (Selenium) и безголовый браузер (безголовым PhantomJS называется потому, что ему не нужен экран что-бы отрендерить страницу, всё происходит в строке).

Итак, если вы решили всерьёз запарсить твиты со страницы, и вас ничего не остановит))))), то вот мой вариант):

Вот этот код можете использовать как «шапку», в ней особо ничего менять не придётся:

Дальше описать взаимодействие со страницей, поможет справка по селениуму (http://selenium-python.readthedocs.io/)

P.S.2 Так же вам нужно будет прокручивать страницу до тех пор, пока не прилетит самый первый твит автора, и только тогда получать нужную вам информацию в переменные

P.S.3 В примере используется time.sleep(10) только как временный костыль, правильней использовать явное ожидание «Explicit Waits» (оно описано в справке к селениуму по ссылке сверху)

P.S.4-Самый главный постскриптум

Предложенный мною вариант не является 100% истинным, другие знающие люди могут предложить вам другие связки и другие методы. Но на мой взгляд у всех методов будет один принцип:

Обрабатывать динамическое содержимое JavaScript’а в Web’е возможно только через приложения предназначенные для этого, то есть через браузеры.

Совет: Что-бы узнать как поведёт себя сайт с отключенным JavaScript’ом используйте дополнение NoScript в браузере Mozilla Firefox

Как парсить твиттер на python

Non API Twitter Parser with Semantics Analysis

Small Python utility which helps you parse and analyze the tweets from Twitter without using the twitter API. This script contain methods which helps you analyze the statistics of tweets including semantics using Deep Learning Recurrent Neural Network algorithms based on Keras, Theano, and/or TensorFlow.

Because the official Twitter API has restrictions on the quantities of API calls and the amount of tweets returned.

First, clone the repository:

In command line open the folder and run python. In python shell import the module:

Now, go to the Twitter advanced search page and fill in form’s fields in which you are interested in, hit ‘Search’ button. When the page is loaded you can adjust the parameters: for instance, you may select ‘News’ tab if you are interested in news related tweets. When everything is set and the Twitter advanced search page loads the desired result, you need to copy the URL address from your browser. Now, run the scrapper with the URI as a string:

It will load Firefox browser and perform scrolling of the page every 0.5 second to load new content. After some time, when you think that it is enough information on the Firefox page, you need to interrupt the script, select all the content in Firefox page ( ctrl-A ), copy it ( ctrl-C ) and paste the text ( ctrl-V ) into txt file, save txt-file in data folder (you may see as an example txt-files already saved there for you, don’t forget to delete them before you start scrapping). You can perform this operation several times depending on your needs.

When all tweets of interest are saved into the data folder, you may run the parser:

By default, the script will search for text files in data folder, but you may specify any folder as input parameter for the method. The script will output some basic info about found files, total amount of parsed tweets and 50 most common words in tweets:

Also, script will return all parsed tweets into the variable prsd_tweets which is list of python dictionaries. The keys are

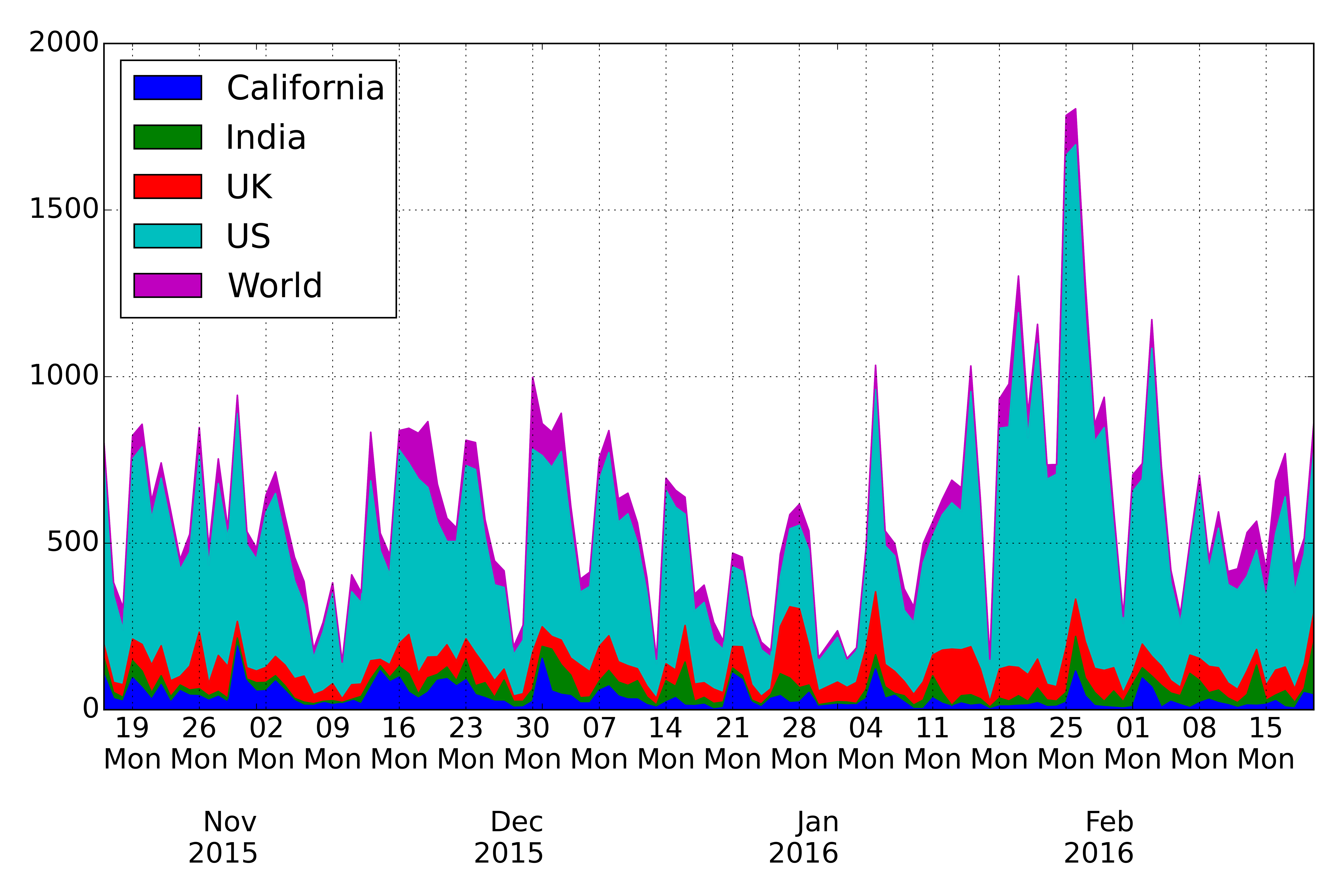

Daily count of tweets containing specific word

You may estimate daily count of words. You may pass words as a list and in this case the script will return the sum of words in the list as in example with [‘world’,’global’]:

It is convenient to save the data as Pandas DataFrame:

The script will return the data frame (for instance last 10 elements):

| California | India | UK | US | World | |

|---|---|---|---|---|---|

| 2015-12-21 | 62 | 7 | 5 | 152 | 35 |

| 2015-12-22 | 60 | 2 | 28 | 154 | 27 |

| 2015-12-23 | 18 | 5 | 10 | 122 | 10 |

| 2015-12-24 | 7 | 5 | 8 | 94 | 15 |

| 2015-12-25 | 30 | 3 | 3 | 69 | 12 |

| 2015-12-26 | 26 | 12 | 42 | 95 | 41 |

| 2015-12-27 | 14 | 25 | 50 | 155 | 22 |

| 2015-12-28 | 19 | 13 | 49 | 152 | 27 |

| 2015-12-29 | 33 | 6 | 26 | 183 | 32 |

| 2015-12-30 | 7 | 1 | 4 | 47 | 8 |

And you can easily plot graphs:

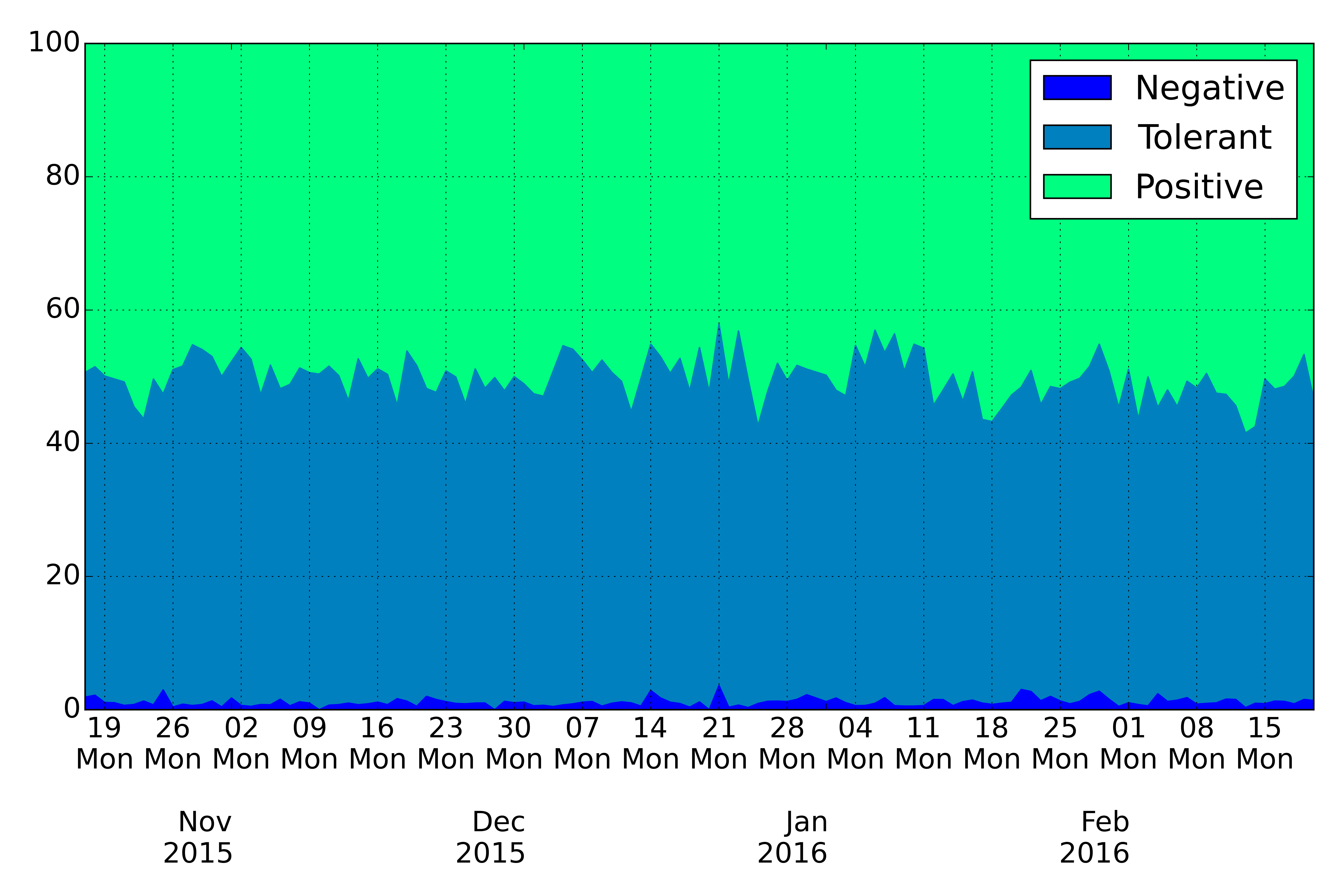

Sentiment of parsed tweets

Now, you may perform the semantics analysis. Unzip the Stanford tweets database stanford_train_data.zip, which is in the folder of repository. Run the model:

It will perform the training of neural network. If you don’t want to wait long you may use already trained Keras weights. Download them using this link and put file in the repository root folder. Run the script again:

The script will update the emo key of dictionaries prsd_tweets much faster without learning of the model. As the output you will see the following:

Now, to see that ’emo’ key is updated, just run:

You may count positive, tolerant and negative sentiment of the tweets containing list of words by:

It will count sentiment of the tweets containing words world and global. Again, for convenient use you may created the Pandas DataFrame:

You will see the result:

| negative | positive | tolerant | |

|---|---|---|---|

| 2015-12-21 | NaN | 37 | 36 |

| 2015-12-22 | NaN | 26 | 17 |

| 2015-12-23 | NaN | 13 | 20 |

| 2015-12-24 | NaN | 7 | 20 |

| 2015-12-25 | NaN | 11 | 6 |

| 2015-12-26 | NaN | 23 | 20 |

| 2015-12-27 | NaN | 37 | 30 |

| 2015-12-28 | NaN | 44 | 39 |

| 2015-12-29 | NaN | 37 | 23 |

| 2015-12-30 | NaN | 19 | 6 |

Now, you may build graphs of polarity of tweets:

Select The Brown dictionary and download it. Then, you may run parsing method:

Collaborators are really welcome!

Please, contact me, if you know how to improve or have ideas about some cool features. Generally, I expect collaborators to create the pull request with new feature/improvement!

The MIT License (MIT)

Copyright (c) 2016 Igor Markelov

Permission is hereby granted, free of charge, to any person obtaining a copy of this software and associated documentation files (the «Software»), to deal in the Software without restriction, including without limitation the rights to use, copy, modify, merge, publish, distribute, sublicense, and/or sell copies of the Software, and to permit persons to whom the Software is furnished to do so, subject to the following conditions:

The above copyright notice and this permission notice shall be included in all copies or substantial portions of the Software.

THE SOFTWARE IS PROVIDED «AS IS», WITHOUT WARRANTY OF ANY KIND, EXPRESS OR IMPLIED, INCLUDING BUT NOT LIMITED TO THE WARRANTIES OF MERCHANTABILITY, FITNESS FOR A PARTICULAR PURPOSE AND NONINFRINGEMENT. IN NO EVENT SHALL THE AUTHORS OR COPYRIGHT HOLDERS BE LIABLE FOR ANY CLAIM, DAMAGES OR OTHER LIABILITY, WHETHER IN AN ACTION OF CONTRACT, TORT OR OTHERWISE, ARISING FROM, OUT OF OR IN CONNECTION WITH THE SOFTWARE OR THE USE OR OTHER DEALINGS IN THE SOFTWARE.

About

Small utility which helps you to parse and analyse the tweets from Twitter without using api

Доступ к данным из Twitter API с использованием R и Python

Дата публикации Oct 29, 2018

Использование Twitter API должно быть простым делом, но иногда картинки и простой код могут сэкономить вам лишние 5 минут. Я уже рассказывал, какДоступ к данным из Twitter API с помощью R, но процесс изменился по состоянию на июль 2018 года.

В этом посте рассказывается о том, как настроить учетную запись разработчика в Твиттере, а затем о том, как вы можете искать твиты с помощью R и Python.

Настройка учетной записи разработчика Twitter и приложения

1-) Создайте аккаунт в твиттере, если у вас его еще нет.

3-) Введите номер телефона, если у вас нет номера, связанного с вашим Twitter.

4-) Добавить данные учетной записи. Нажмите на продолжить.

5-) Опишите своими словами, что вы строите. Нажмите на продолжить.

7-) Проверьте свою электронную почту, связанную с вашим твиттером, и нажмите «Подтвердить вашу электронную почту»

😎 На экране приветствия нажмите «Создать приложение».

9-) Заполните данные вашего приложения и нажмите кнопку «Создать» (внизу страницы). Убедитесь, что вы не пытаетесь создать имя приложения, которое уже занято.

Ознакомьтесь с Условиями для разработчиков и нажмите «Создать».

10-) Сначала нажмите на Ключи и жетоны. Во-вторых, нажмите «Создать», чтобы получить токен доступа и получить доступ к секретному токену.

Сохраните свой ключ API, секретный ключ API, токен доступа и секретный токен доступа в безопасном месте. Я должен отметить, что вы не должны пытаться копировать мои ключи, так как я восстановил их после этого урока.

API Twitter

питон

В приведенном ниже коде используется пакет python-twitter (его можно установить с помощью pip install python-twitter ) для поиска. Вы можете узнать, как сделать свой собственный запросВот,

Вывод

Это руководство было о том, как начать работу с Twitter API. Если у вас есть какие-либо вопросы или мысли по поводу учебника, не стесняйтесь обращаться в комментариях ниже или черезщебет, Если вы хотите узнать, как использовать библиотеки Pandas, Matplotlib или Seaborn, рассмотрите возможностьPython для визуализации данных Учебный курс LinkedIn,

Доступ к API Twitter с помощью Python

Вступление

Обзор API Twitter

На платформе Twitter существует множество API, с которыми могут взаимодействовать разработчики программного обеспечения, с конечной возможностью создания полностью автоматизированных систем, которые будут взаимодействовать с Twitter. Хотя эта функция может принести пользу компаниям, черпая информацию из данных Twitter, она также подходит для небольших проектов, исследований и развлечений. Вот несколько наиболее заметных API, предоставляемых Twitter:

Есть еще много возможностей с API Twitter, которые не включены в этот список. Twitter также постоянно расширяет свой спектр услуг, время от времени добавляя новые API и обновляя существующие.

Получение учетных данных

Прежде чем использовать Twitter API, вам сначала понадобится учетная запись Twitter и получить некоторые учетные данные. Процесс получения учетных данных может измениться со временем, но в настоящее время он выглядит следующим образом:

И это все. Потребительский ключ/секрет используется для аутентификации приложения, использующего Twitter API, в то время как маркер доступа/секрет аутентифицирует пользователя. Все эти параметры должны рассматриваться как пароли и не должны включаться в ваш код в виде обычного текста. Один из подходящих способов-сохранить их в JSON-файле” twitter_credentials.json ” и при необходимости загрузить эти значения из вашего кода.

Обертки Python

Таблица 1 : Библиотеки Python для Twitter API упорядочены по количеству полученных звезд.