Как парсить таблицу html python

Парсинг на Python с Beautiful Soup

Парсинг — это распространенный способ получения данных из интернета для разного типа приложений. Практически бесконечное количество информации в сети объясняет факт существования разнообразных инструментов для ее сбора. В процессе скрапинга компьютер отправляет запрос, в ответ на который получает HTML-документ. После этого начинается этап парсинга. Здесь уже можно сосредоточиться только на тех данных, которые нужны. В этом материале используем такие библиотеки, как Beautiful Soup, Ixml и Requests. Разберем их.

Установка библиотек для парсинга

Чтобы двигаться дальше, сначала выполните эти команды в терминале. Также рекомендуется использовать виртуальную среду, чтобы система «оставалась чистой».

Поиск сайта для скрапинга

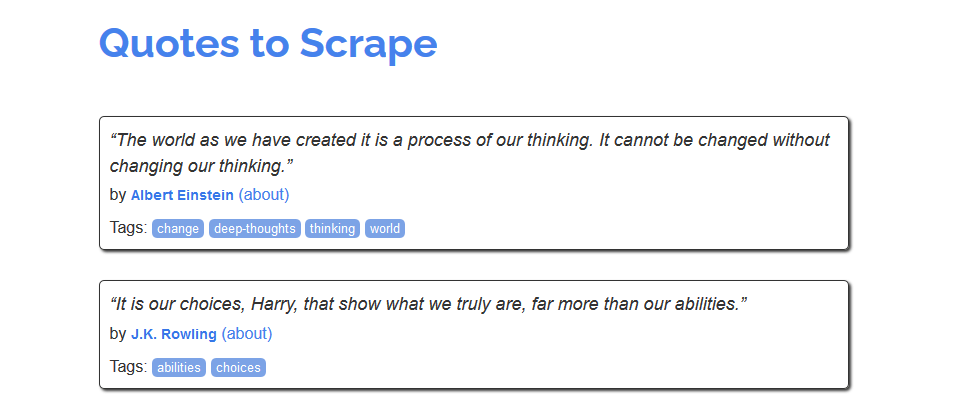

Для знакомства с процессом скрапинга можно воспользоваться сайтом https://quotes.toscrape.com/, который, похоже, был создан для этих целей.

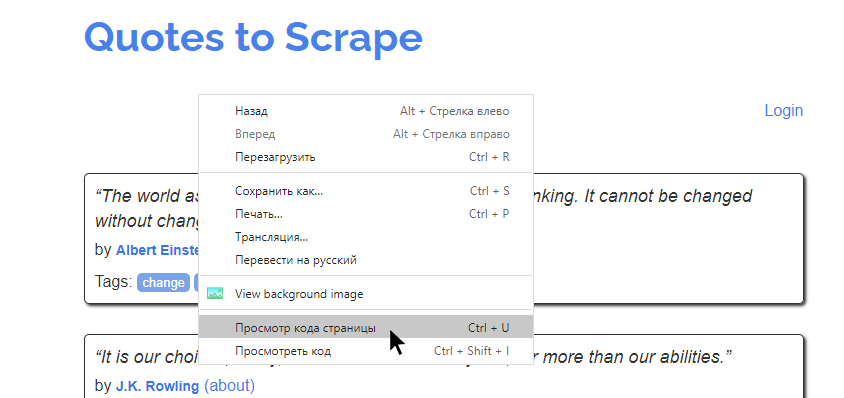

Из него можно было бы создать, например, хранилище имен авторов, тегов или самих цитат. Но как это сделать? Сперва нужно изучить исходный код страницы. Это те данные, которые возвращаются в ответ на запрос. В современных браузерах этот код можно посмотреть, кликнув правой кнопкой на странице и нажав «Просмотр кода страницы».

На экране будет выведена сырая HTML-разметка страница. Например, такая:

На этом примере можно увидеть, что разметка включает массу на первый взгляд перемешенных данных. Задача веб-скрапинга — получение доступа к тем частям страницы, которые нужны. Многие разработчики используют регулярные выражения для этого, но библиотека Beautiful Soup в Python — более дружелюбный способ извлечения необходимой информации.

Создание скрипта скрапинга

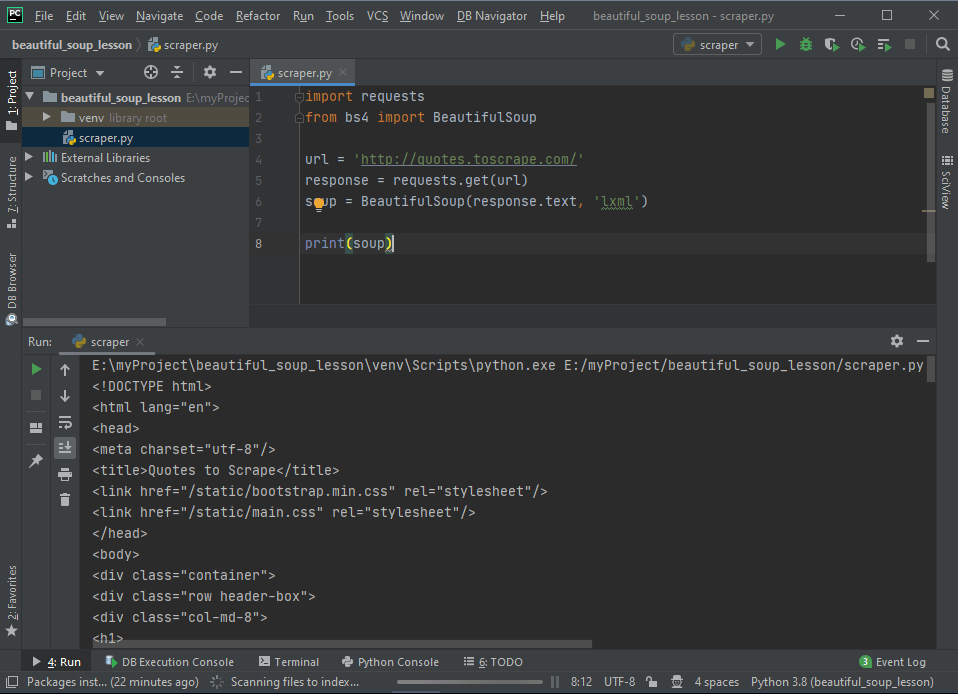

В PyCharm (или другой IDE) добавим новый файл для кода, который будет отвечать за парсинг.

Вот что происходит: ПО заходит на сайт, считывает данные, получает исходный код — все по аналогии с ручным подходом. Единственное отличие в том, что в этот раз достаточно лишь одного клика.

Прохождение по структуре HTML

Написанный скрипт уже получает данные о разметке из указанного адреса. Дальше нужно сосредоточиться на конкретных интересующих данных.

Таким образом и происходит дешифровка данных, которые требуется получить. Сперва нужно найти некий шаблон на странице, а после этого — создать код, который бы работал для него. Можете поводить мышью и увидеть, что это работает для всех элементов. Можно увидеть соотношение любой цитаты на странице с соответствующим тегом в коде.

Скрапинг же позволяет извлекать все похожие разделы HTML-документа. И это все, что нужно знать об HTML для скрапинга.

Парсинг HTML-разметки

Урок 3. Парсинг таблиц на Python

Постановка задачи

В этом уроке, мы продолжим цикл статей по парсингу на Python, и рассмотрим парсинг таблиц на Python. В предыдущем уроке, мы с вами разобрались с тем, как парсить обычные сайты. В этом уроке рассмотрим парсинг на Python на примере сайта премьер лиги россии по футболу. На странице по ссылке, мы увидим турнирную таблицу чемпионата.

Анализ структуры html страницы

Табличные данные в html отличаются своими тегами от того, что мы парсили в предыдущем уроке. В любом случае, эта стья подразумевает, что вы уже знакомы с html тегами, и css селекторами, хотя последнее в этой статье использоваться не будет.

Рассмотрим структуру html:

Создание парсера

В этом уроке, я уже не буду подробно объяснять функции, которые тут описаны. Подробнее о том, что делает та или иная функция, можно почитать:

И так, ниже я выложу весь листинг кода, и мы по порядку разберемся, как устроен внутренний механизм данного парсера.

На этом этапе, мы уже получили все данные, которые планировали.

В случае, если у вас где то возникает ошибка, пишите в комментариях. Разберем вашу проблему.

Запись в csv

Основы парсинга с помощью Python+lxml

Добрый день, уважаемые читатели.

В сегодняшней статье я покажу основы разбора HTML разметки страниц с помощью библиотеки lxml для Python.

Если вкратце, то lxml это быстрая и гибкая библиотека для обработки разметки XML и HTML на Python. Кроме того, в ней присутствует возможность разложения элементов документа в дерево. В статье я постараюсь показать, насколько просто ее применение на практике.

Выбор цели для парсинга

Т.к. я активно занимаюсь спортом, в частности БЖЖ мне захотелось посмотреть статисту по болевым приемам во все проведенных турнирах мировых турнирах по MMA.

Поиски по гулу привели меня на сайт со всей официальной статистикой по крупным международным турнирам по смешанным единоборствам. Единственной загвоздкой было то, что информация на нам была представлена в неудобном для анализа виде. Это связано с тем, что результаты турниров находится отдельных страницах. Кроме того, дата турнира также с его названием вынесены на отдельную страницу отдельной странице.

Чтобы объединить всю информацию по турнирам в одну таблицу, пригодную для анализа, было принято решение написать парсер описанный ниже.

Алгоритм работы парсера

Начало работы с lxml

Для работы нам понадобятся модули lxml и pandas. Подгрузим их в нашу программу:

Для удобства дальнейшего парсинга вынесем основной домен в отдельную переменную:

Теперь давайте получим объект для парсинга. Сделать это можно с помощью функции parse():

Разберемся, что делает данный код.

Сначала с помощью функции getroot() мы получаем корневой элемент нашего документа (это нужно для последующей работы с документом).

Далее, с помощью функции find_class() мы находим все элементы с указанными классами. В результате работы функции мы получим список таких элементов. Т.к. после визуального анализа HTML кода страницы видно, что по данному критерию подходит только один элемент, то мы извлекаем его из списка с помощью функции pop().

Теперь надо получить таблицу из нашего div‘a, полученного ранее. Для этого воспользуемся методом getchildren(), который возвращает список подчерненных объектов текущего элемента. И

потому, что у нас только один такой объект, ты мы извлекаем этот его из списка.

Теперь переменная t содержит таблицу с необходимой для нас информацией. Теперь, я получу 2 вспомогательных dataframe’a, объединив которые, мы получим данные о турнирах с датами их проведения и ссылками на результаты.

В первый набор я включу все названия турниров и ссылки на их страницы на сайте. Это легко сделать с помощью итератора iterlinks(), который возвращает список котрежей (элемент, атрибут,

адрес ссылки, позиция ) внутри заданного элемента. Собственно, из этого кортежа, нам нужен адрес ссылки и ее текст.

Тест ссылки можно получить обративший к свойству .text соответсвующего элемента. Код будет следующим:

Внимательный читатель заметит, что в цикле мы исключаем первые 5 записей. В них содержится не нужная нам информация, типа заголовков полей, поэтому я от них и избавился.

Итак, ссылки мы получили. Теперь получим 2 поднабор данных с датами проведения турниров. Это можно сделать так:

Теперь, когда у нас есть 2 поднабора данных, объединим их в итоговый набор:

Тут, мы сначала указываем индексы нашим наборам, затем объединяем их и сбрасываем индексы итогового набора. Подробнее о этих операция можно прочитать в одной из моих прошлых статей. Осталось выгрузить полученный dataframe в текстовый файл, для сохранности:

Обработчик события одного события UFC

Страницу с перечнем турниров мы выгрузили в удобном формате. Пришло время разобраться со страницами с результатами по соревнований. Для примера возьмем последний турнир и посмотрим HTML код страницы.

Можно заметить, что нужная нам информация содержится в элементе с классом data_table row_is_link. В целом процесс парсинга похож на показанный выше, за одним исключением: таблица результатов оформлена не совсем корректно.

Некорретность ее в том, что для каждого бойца в ней заведена отдельная строка, что никак не удобно при анализе. Чтобы избавиться от этого неудобства при разборе результатов я принял решение использовать итератор, только по нечетным строкам. Номер же четной вычислять из текущей нечетной строки.

Таким образом я буду обрабатывать сразу пару строк и переносить их в строку. Код будет следующий:

Можно заметить, что для каждого поединка дополнительно записывается название турнира. Это нужно для того, чтобы определить дату поединка.

Сохраним теперь полученные результаты в файл:

Как парсить таблицу html python

Данные для Data Science проектов можно получать ото всюду, в том числе и с веб-сайтов, например, страниц Википедии. Сегодня мы расскажем, как извлечь все таблицы из веб-страницы с помощью функции read_html Python-библиотеки Pandas, а также обработать полученные данные, включая нормализацию и приведение типов.

Как работает парсинг сайтов

В Pandas есть функция — read_html, которая использует одну из библиотек для парсинга веб-страниц: BeautifulSoup4, html5lib или lxml. По умолчанию в Pandas стоит lxml, однако, в случае ее отсутствия будет применяться другая. Поэтому для корректного выполнения хотя бы одна из них должна быть установлена. Установить lxml можно, выполнив следующую операцию в командной строке:

Одна из перечисленных Python-библиотек ищет на указанной веб-странице все таблицы под тэгом

Статистика заболеваний по странам и территориям

Статистика заболеваний по странам и территориям Обработанная таблица

Обработанная таблица

Поискового робота обычно называют «пауком». Это технология искусственного интеллекта, которая просматривает Интернет, индексирует и ищет контент по заданным ссылкам. Он ищет соответствующую информацию, запрошенную программистом.

Поискового робота обычно называют «пауком». Это технология искусственного интеллекта, которая просматривает Интернет, индексирует и ищет контент по заданным ссылкам. Он ищет соответствующую информацию, запрошенную программистом. Веб-скрапер – это специальный инструмент, предназначенный для быстрого и эффективного извлечения данных с нескольких веб-сайтов. Веб-скраперы сильно различаются по дизайну и сложности в зависимости от проекта.

Веб-скрапер – это специальный инструмент, предназначенный для быстрого и эффективного извлечения данных с нескольких веб-сайтов. Веб-скраперы сильно различаются по дизайну и сложности в зависимости от проекта.