Как оценить теоретическое количество информации

Методы оценки количества информации

Как и для характеристик вещества, так и для характеристик информации имеются единицы измерения, что позволяет некоторой порции информации приписывать числа — количественные характеристики информации.

На сегодняшний день наиболее известны следующие способы измерения информации:

Объемный является самым простым и грубым способом измерения информации. Соответствующую количественную оценку информации естественно назвать объемом информации.

Объем информации в сообщении —- это количество символов ( разрядов) в сообщении.

Поскольку, например, одно и то же число может быть записано многими разными способами (с использованием разных алфавитов):

то этот способ соотносится с формой представления (записи) сообщения.

В различных системах счисления один разряд имеет различный вес и соответственно меняется единица измерения данных:

Для удобства использования введены и более крупные, чем бит, единицы количества информации: 1 байт = 8 битов

Пример: Сообщение в двоичной системе 1011110112=8 бит=1 байт

Сообщение в десятичной системе 275903 = 6 дит

Энтропийный подход к измерению информации принят в теории информации и кодирования. Этот способ измерения исходит из следующей модели. Получатель информации (сообщения) имеет определенные представления о возможных наступлениях некоторых событий. Эти представления в общем случае недостоверны и выражаются вероятностями, с которыми он ожидает то или иное событие. Общая мера неопределенности (энтропия) характеризуется некоторой математической зависимостью от совокупности этих вероятностей.

Чтобы возник процесс передачи, должны иметь место источник информации и потребитель. Источник выдает сообщение, потребитель, принимая сообщение, получает при этом информацию о состоянии источника. В статической теории не изучается содержание информации. Предполагается, что до получения информации имела место некоторая неопределённость. С получением информации эта неопределенность снимается.

Таким образом, статистическая количественная мера информации – это мера снимаемой в процессе получения информации неопределенности системы. Количество информации зависит от закона распределения состояния системы.

Семантический подход базируется на ценности информации. Термин «семантика» исторически применялся в металогике и семиотике. В металогике под семантикой понимается совокупность правил соответствия между формальными выражениями и их интерпретацией (истолкованием). Под семиотикой понимают комплекс научных теорий, изучающих свойства знаковых систем, т.е. систем конкретных или абстрактных объектов, с каждым из которых сопоставлено некоторое значение. Примерами знаковых систем являются естественные языки и искусственные языки: алгоритмические языки, языки программирования, информационные языки и др. Обобщенно термин «знаковые языки» подразумевает любые устройства, рассматриваемые как «черные ящики». В информатике языки различного уровня занимают все большее место.

Семантическая теория оценивает содержательный аспект информации, семантический подход базируется на анализе её ценности. Ценность информации связывают со временем, поскольку с течением времени она стареет и ценность её, а следовательно и «количество» уменьшается.

Семантический подход имеет особое значение при использовании информации для управления, т.к. количество информации тесно связано с эффективностью управления в системе.

Структурный подход рассматривает построение информационных массивов, что имеет особое значение при хранении информации. Универсальным средством как оперативного, так и долговременного хранения различной информации стали ЭВМ. Оценка количества информации с позиций структурного подхода оказывается исключительно плодотворной, так как за единицы информации принимаются некоторые «ранговые» структурные единицы: реквизиты – логически неделимые элементы документации, описывающие определенные свойства объекта (реквизиты – основания, определяющие числовые данные: вес, количество, стоимость, номер, год, реквизиты – признаки: фамилия, цвет, марка), записи, информационные массивы, комплексы информационных массивов, информационная база, банк данных.

Структурный подход к оценке количества информации в настоящее время приобретает все большее значение, поскольку необходимо оценивать все возрастающее количество хранимой информации.

Таким образом, статистическая количественная характеристика информации – это мера снимаемой в процессе получения информации неопределенности системы. Количество информации зависит от закона распределения состояний системы.

В зависимости от вида перерабатываемой информации (вида сообщений) вычислительные машины и устройства делят на два основных класса: аналоговые (непрерывного действия) и цифровые (дискретные).

Аналоговые вычислительные машины (АВМ) оперируют с информацией, представленной в виде непрерывных изменений некоторых физических величин (ток, напряжение, угол поворота, скорость движения тела и т.п.). Используя тот факт, что многие явления в природе, обществе, технике математически описываются одними и теми же уравнениями, АВМ обычно предназначаются для решения определенного класса задач.

Объектом передачи и преобразования в цифровых вычислительных машинах (ЭВМ) являются дискретные сообщения, как уже отмечалось выше, формируемые из различных последовательностей элементов. Элементы (цифры, буквы, математические знаки, цвета сигнальных ламп и др.), из которых состоят дискретные сообщения, называются символами. Фиксируемый конечный набор символов составляет алфавит, а число символов в алфавите – объем алфавита.

Заложенные еще К. Шенноном принципы количественной оценки информации на основе функции энтропии, сохраняют свою значимость до настоящего времени и являются полезными при определении информативности символов и сообщений.

Подходы к оценке количества информации

Содержание:

Введение

Понимая информацию как один из основных стратегических ресурсов, без которого невозможна деловая, управленческая, вообще любая социально значимая деятельность, необходимо уметь оценивать ее как с качественной, так и с количественной стороны. На этом пути существуют большие проблемы из-за нематериальной природы этого ресурса и субъективности восприятия конкретной информации различными индивидуумами человеческого общества. С этой точки зрения классификация информации является важнейшим средством создания систем хранения и поиска информации, без которых сегодня невозможно эффективное функционирование информационного обеспечения управления.

Целью работы является рассмотрение видов информации, областей применения и подходов к ее количественной оценке. Для этого нужно рассмотреть следующие задачи и вопросы. Первой задачей является изучение общих понятий по данной теме. Рассмотрение конкретных способов оценки количества информации – вторая задача.

Что такое информация и ее классификация

Термин «информация» происходит от латинского слова «informatio», что означает сведения, разъяснения, изложение. Несмотря на широкое распространение этого термина, понятие информации является одним из самых дискуссионных в науке. В настоящее время наука пытается найти общие свойства и закономерности, присущие многогранному понятию информация, но пока это понятие во многом остается интуитивным и получает различные смысловые наполнения в различных отраслях человеческой деятельности:

· в обиходе информацией называют любые данные или сведения, которые кого-либо интересуют. Например, сообщение о каких-либо событиях, о чьей-либо деятельности и т.п. «Информировать» в этом смысле означает «сообщить нечто, неизвестное раньше»;

· в технике под информацией понимают сообщения, передаваемые в форме знаков или сигналов;

· в кибернетике под информацией понимает ту часть знаний, которая используется для ориентирования, активного действия, управления, т.е. в целях сохранения, совершенствования, развития системы (Н. Винер).

Клод Шеннон, американский учёный, заложивший основы теории информации — науки, изучающей процессы, связанные с передачей, приёмом, преобразованием и хранением информации, — рассматривает информацию как снятую неопределенность наших знаний о чем-то.

Применительно к информации как к объекту классификации выделенные классы называют информационными объектами. С этой точки зрения классификация информации является важнейшим средством создания систем хранения и поиска информации, без которых сегодня невозможно эффективное функционирование информационного обеспечения управления. Классификация носит всеобщий характер вследствие той роли, которую она играет как инструмент научного познания, прогнозирования и управления. Одновременно классификация выполняет функцию объективного отражения и фиксации результатов этого познания. при этом характер классификационной схемы, состав признаков классификации и глубина классификации определяется теми практическими целями, для реализации которых используется классификация, типом объектов классификации, а также условиями, в которых классификация будет использоваться.

1.2 Виды информации

Основные виды информации по ее форме представления, способам ее кодирования и хранения, что имеет наибольшее значение для информатики, это:

1. Графическая или изобразительная — первый вид, для которого был реализован способ хранения информации об окружающем мире в виде наскальных рисунков, а позднее в виде картин, фотографий, схем, чертежей на бумаге, холсте, мраморе и др. материалах, изображающих картины реального мира;

2. Звуковая — мир вокруг нас полон звуков и задача их хранения и тиражирования была решена с изобретение звукозаписывающих устройств в 1877 г. ее разновидностью является музыкальная информация — для этого вида был изобретен способ кодирования с использованием специальных символов, что делает возможным хранение ее аналогично графической информации;

3. Текстовая — способ кодирования речи человека специальными символами — буквами, причем разные народы имеют разные языки и используют различные наборы букв для отображения речи; особенно большое значение этот способ приобрел после изобретения бумаги и книгопечатания;

4. Числовая — количественная мера объектов и их свойств в окружающем мире; особенно большое значение приобрела с развитием торговли, экономики и денежного обмена; аналогично текстовой информации для ее отображения используется метод кодирования специальными символами — цифрами, причем системы кодирования (счисления) могут быть разными;

5. Видеоинформация — способ сохранения «живых» картин окружающего мира, появившийся с изобретением кино.

1.3 Виды подходов к оценке количества информации

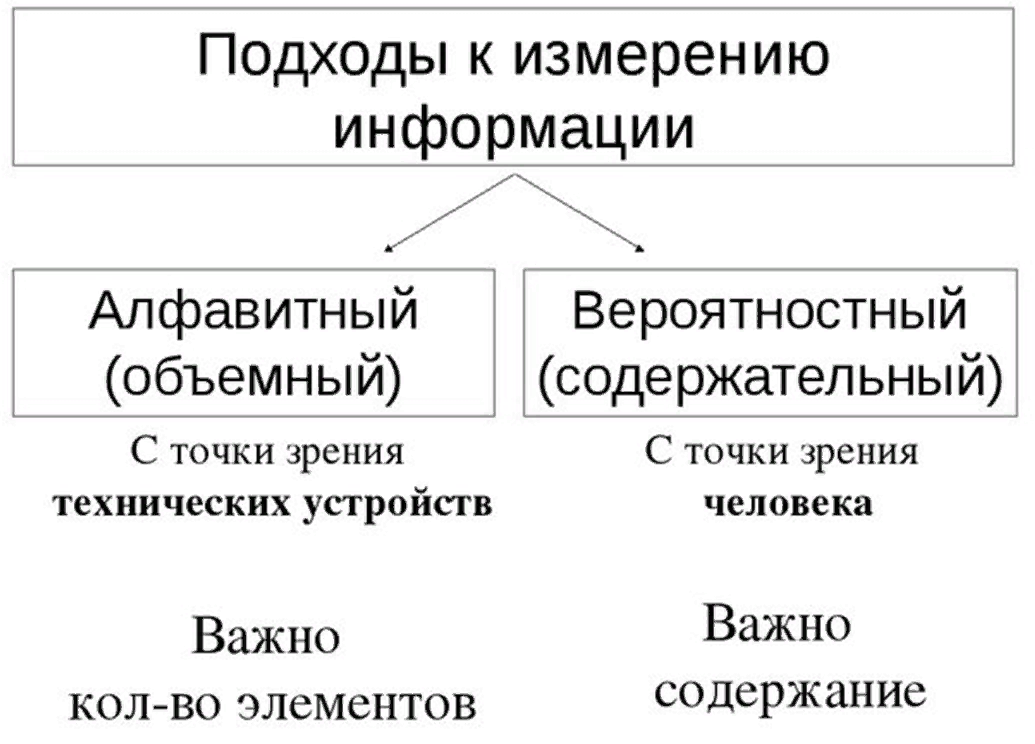

При всем многообразии подходов к определению понятия информации, с позиции измерения информации нас будут интересовать два из них: определение К. Шеннона, применяемое в математической теории информации (содержательный подход), и определение А. Н. Колмогорова, применяемое в отраслях информатики, связанных с использованием компьютеров (алфавитный подход). (рисунок 1)

1.4 Содержательный подход

Содержательный подход к измерению информации.

Для человека информация — это знания человека. Рассмотрим вопрос с этой точки зрения.

Получение новой информации приводит к расширению знаний. Если некоторое сообщение приводит к уменьшению неопределенности нашего знания, то можно говорить, что такое сообщение содержит информацию.

Отсюда следует вывод, что сообщение информативно (т.е. содержит ненулевую информацию), если оно пополняет знания человека.

Но для того чтобы сообщение было информативно оно должно еще быть понятно. Быть понятным, значит быть логически связанным с предыдущими знаниями человека.

Получение всяких знаний должно идти от простого к сложному. И тогда каждое новое сообщение будет в то же время понятным, а значит, будет нести информацию для человека.

Сообщение несет информацию для человека, если содержащиеся в нем сведения являются для него новыми и понятными.

Очевидно, различать лишь две ситуации: «нет информации» — «есть информация» для измерения информации недостаточно. Нужна единица измерения, тогда мы сможем определять, в каком сообщении информации больше, в каком — меньше.

Единица измерения информации была определена в науке, которая называется теорией информации. Эта единица носит название «бит». Ее определение звучит так: сообщение, уменьшающее неопределенность знаний в два раза, несет 1 бит информации.

Проще всего определить объем информации в том случае, когда все результаты события могут быть реализованы с равной вероятностью. В этом случае формула Хартли используется для расчета информации.

Формула Хартли была предложена в 1928 году американским инженером Р.Хартли. Она связывает количество равновероятных состояний N с количеством информации I в сообщении о том, что любое из этих состояний реализовалось. Наиболее простая форма для данной формулы записывается следующим образом: 2I = N

Причем обычно значение N известно, а I приходится подбирать, что не совсем удобно. Поэтому те, кто знает математику получше, предпочитают преобразовать данную формулу так, чтобы сразу выразить искомую величину I в явном виде: I = log2 N

В более сложной ситуации, когда исход события ожидается с различной степенью достоверности, требуются более сложные вычисления с использованием формулы Шеннона.

где pi — вероятность того, что именно i-е сообщение выделено в наборе из N сообщений.

1.5 Алфавитный подход

Алфавитный подход используется для измерения количества информации в тексте, представленном в виде последовательности символов некоторого алфавита. Такой подход не связан с содержанием текста. Количество информации в этом случае называется информационным объемом текста, который пропорционален размеру текста — количеству символов, составляющих текст. Иногда данный подход к измерению информации называют объемным подходом.

Каждый символ текста несет определенное количество информации. Его называют информационным весом символа. Поэтому информационный объем текста равен сумме информационных весов всех символов, составляющих текст.

Если допустить, что все символы алфавита встречаются в тексте с одинаковой частотой (равновероятно), то количество информации, которое несет каждый символ, вычисляется по формуле Хартли:

Формула Хартли задает связь между количеством возможных событий N и количеством информации i :

Заключение

Между вероятностным и объемным количеством информации соотношение неоднозначное. Далеко не всякий текст, записанный двоичными символами, допускает измерение объема информации в вероятностном (кибернетическом) смысле, но заведомо допускает его в объемном. Далее, если некоторое сообщение допускают измеримость количества информации в обоих смыслах, то это количество не обязательно совпадает, при этом кибернетическое количество информации не может быть больше объемного. В прикладной информатике практически всегда количество информации понимается в объемном смысле. Как ни важно измерение информации, нельзя сводить к нему все связанные с этим понятием проблемы. При анализе информации социального происхождения на первый план могут выступить такие ее свойства как истинность, своевременность, ценность, полнота и т.д. Их невозможно оценить в терминах «уменьшение неопределенности» (вероятностный подход) или числа символов (объемный подход). Обращение к качественной стороне информации породило иные подходы к ее оценке.

Литература

При копировании любых материалов с сайта evkova.org обязательна активная ссылка на сайт www.evkova.org

Сайт создан коллективом преподавателей на некоммерческой основе для дополнительного образования молодежи

Сайт пишется, поддерживается и управляется коллективом преподавателей

Whatsapp и логотип whatsapp являются товарными знаками корпорации WhatsApp LLC.

Cайт носит информационный характер и ни при каких условиях не является публичной офертой, которая определяется положениями статьи 437 Гражданского кодекса РФ. Анна Евкова не оказывает никаких услуг.

Подходы к оценке количества информации

Содержание:

| Предмет: | Информатика |

| Тип работы: | Реферат |

| Язык: | Русский |

| Дата добавления: | 13.04.2019 |

Если вам тяжело разобраться в данной теме напишите мне в whatsapp разберём вашу тему, согласуем сроки и я вам помогу!

По этой ссылке вы сможете найти рефераты по информатике на любые темы и посмотреть как они написаны:

Посмотрите похожие темы возможно они вам могут быть полезны:

Введение:

Как измерить информацию? Часто мы говорим, что, прочитав статью в журнале или просмотрев новости, не получили никакой информации, или наоборот, краткое сообщение может оказаться для нас информативным. В то же время для другого человека та же самая статья может оказаться чрезвычайно информативной, а сообщение — нет.

Информативными сообщения являются тогда, когда они новы, понятны, своевременны, полезны. Но то, что для одного понятно, для другого — нет. То, что для одного полезно, ново, для другого — нет. В этом проблема определения и измерения информации.

При всем многообразии подходов к определению понятия информации, с позиции измерения информации нас будут интересовать два из них: определение К. Шеннона, применяемое в математической теории информации (содержательный подход), и определение А. Н. Колмогорова, применяемое в отраслях информатики, связанных с использованием компьютеров (алфавитный подход).

Вероятностный подход к измерению информации

Любая информация может рассматриваться как уменьшение неопределенности наших знаний об окружающем нас мире (в теории информации принято говорить об уменьшении неопределенности, а не об увеличении объема знаний). Математически это утверждение эквивалентно простой формуле:

Важным частным случаем является ситуация, когда определенное событие с несколькими возможными исходами уже произошло, что означает, что неопределенность его результата исчезла. Тогда H2 = 0 и формула для информации упрощается: Я = ч.

Расчет энтропии в вероятностном подходе основан на рассмотрении данных о результате некоторого случайного события, то есть события, которое может иметь несколько результатов. Случайность события заключается в том, что реализация результата имеет определенную степень неопределенности.

Предположим, например, что совершенно незнакомый нам студент сдает экзамен, результатом которого могут быть 2, 3, 4 или 5 классы. Поскольку мы ничего не знаем об этом студенте, степень неопределенности всех перечисленные результаты экзамена точно такие же. Напротив, если мы знаем, как он учится, то уверенность в некоторых результатах будет больше, чем в других: например, превосходный ученик, скорее всего, сдаст экзамен на пятерку лучших, а получить двойку для него почти невероятно.

Проще всего определить объем информации в том случае, когда все результаты события могут быть реализованы с равной вероятностью. В этом случае формула Хартли используется для расчета информации. В более сложной ситуации, когда исход события ожидается с различной степенью достоверности, требуются более сложные вычисления с использованием формулы Шеннона. Очевидно, формула Хартли является частным случаем более общей формулы Шеннона.

Формула Хартли была предложена в 1928 году американским инженером Р.Хартли. Она связывает количество равновероятных состояний N с количеством информации I в сообщении о том, что любое из этих состояний реализовалось. Наиболее простая форма для данной формулы записывается следующим образом:

Причем обычно значение N известно, а I приходится подбирать, что не совсем удобно. Поэтому те, кто знает математику получше, предпочитают преобразовать данную формулу так, чтобы сразу выразить искомую величину I в явном виде:

Важный частный случай получается из приведенной формулы при N = 2, когда результатом вычисления является единичное значение. Единица информации носит название бит (от англ. BInary digiT — двоичная цифра); таким образом, 1 бит — это информация о результате опыта с двумя равновероятными исходами. Чем больше возможных исходов, тем больше информации в сообщении о реализации одного из них.

Пример 1. Из колоды выбрали 16 карт, все «картинки» и тузы, и положили на стол рисунком вниз. Верхнюю карту перевернули. Сколько информации будет заключено в сообщении о том, какая именно карта оказалась сверху?

Все карты одинаковы, поэтому любая из них могла быть перевернута с одинаковой вероятностью. В таких условиях применима формула Хартли.

Событие, заключающееся в открытии верхней карты, для нашего случая могло иметь 16 возможных исходов. Следовательно, информация о реализации одного из них равняется:

Пример 2. Решите предыдущую задачу для случая, когда сообщение об исходе случайного события было следующим: «верхняя перевернутая карта оказалась черной дамой».

Отличие данной задачи от предыдущей заключается в том, что в результате сообщения об исходе случайного события не наступает полной определенности: выбранная карта может иметь одну из двух черных мастей.

В этом случае, прежде чем воспользоваться формулой Хартли, необходимо вспомнить, что информация есть уменьшение неопределенности знаний:

До переворота карты неопределенность (энтропия) составляла:

В итоге информация вычисляется следующим образом:

Заметим, что в случае, когда нам называют карту точно неопределенность результата исчезает, N2 = 1, и мы получаем «традиционную» формулу Хартли. И еще одно полезное наблюдение. Полная информация о результате рассматриваемого опыта составляет 4 бита. В данном же случае мы получили 3 бита информации, а оставшийся четвертый описывает сохранившуюся неопределенность выбора между двумя дамами черной масти.

Определим теперь, являются ли равновероятными сообщения «первой выйдет из дверей здания женщина» и «первым выйдет из дверей здания мужчина». Однозначно ответить на этот вопрос нельзя. Все зависит от того, о каком именно здании идет речь. Если это, например, станция метро, то вероятность выйти из дверей первым одинакова для мужчины и женщины, а если это военная казарма, то для мужчины эта вероятность значительно выше, чем для женщины.

Для задач такого рода американский учёный Клод Шеннон предложил в 1948 г. другую формулу определения количества информации, учитывающую возможную неодинаковую вероятность сообщений в наборе.

где pi — вероятность того, что именно i-е сообщение выделено в наборе из N сообщений

Легко заметить, что если вероятности pi равны, то каждая из них равна 1/N, и формула Шеннона превращается в формулу Хартли.

Алфавитный подход

Помимо вероятностного подхода к измерению информации, описанного выше, заключающегося в вычислении неопределенности исхода события, существует и другой. Его часто называют объемным, и он состоит в определении объема информации в каждом из символов отдельного сообщения с последующим подсчетом количества этих символов в сообщении.

Самый простой способ подсчета заключается в следующем. Пусть алфавит, в котором записаны все сообщения, состоит из М символов. Для простоты предположим, что все они появляются в тексте с одинаковой вероятностью, конечно, это грубая модель3, но очень простая. Затем в рассматриваемом параметре формула Хартли применима для расчета информации об одном из результатов события появлении любого символа алфавита:

Поскольку все символы «равны», естественно, что количество информации в каждом из них одинаково. Поэтому осталось умножить полученное значение I на количество символов в сообщении, и мы получим общее количество информации в нем. Мы напоминаем читателям, что значимость сообщения в описанной процедуре нигде не требуется, наоборот, именно в отсутствие смысла предположение о том, что все символы выглядят одинаково, наиболее вероятно выполняется.

Можно показать, что при любом варианте кодирования:

чем экономичнее способ кодирования, тем меньше разница между этими величинами — см. пример 4, приведенный ниже.

Пример 3. Определить информацию, которую несет в себе 1-й символ в кодировках ASCII и Unicode.

В алфавите ASCII предусмотрено 256 различных символов, т.е. M = 256, а

I = log2 256 = 8 бит = 1 байт

В современной кодировке Unicode заложено гораздо большее количество символов. В ней определено 256 алфавитных страниц по 256 символов в каждой. Предполагая для простоты, что все символы используются, получим, что:

I = log2 (256 * 256) = 8 + 8 = 16 бит = 2 байта

Пример 4. Текст, хранящийся в коде ASCII, состоит исключительно из арифметических примеров, которые написаны с использованием 10 цифр от 0 до 9, 4 знаков арифметических операций, знака равенства и некоторого служебного кода, который отделяет примеры друг от друга. Сравните количество информации, которую несет один символ такого текста, используя вероятностный и алфавитный подходы.

Нетрудно подсчитать, что общий текст, рассматриваемый в задании, состоит из N = 16 различных символов. Следовательно, согласно формуле Хартли:

Двойное превышение кодировки символов связано с тем, что не все коды ASCII востребованы в нашем тексте. В то же время нетрудно построить вариант специализированного 4-битного кодирования для конкретной задачи 4, для которого I-вероятностный и I-алфавитный алгоритмы оказываются равными.

Первичные единицы

Мы сравниваем вероятностный и алфавитный подходы. Первый подход позволяет нам рассчитать предельное, минимально возможное теоретическое значение объема информации, которая несет сообщение об этом исходе события. Во-вторых, сколько информации на практике, с учетом конкретной выбранной кодировки. Очевидно, что первая величина является однозначной характеристикой рассматриваемого события, а вторая также зависит от метода кодирования: в «идеальном» случае обе величины совпадают, однако на практике используемый метод кодирования может иметь некоторую степень избыточность.

С рассматриваемой точки зрения вероятностный подход имеет преимущество. Но, с другой стороны, алфавитный метод заметно проще и с некоторых позиций (например, для вычисления необходимого объема памяти) более полезен.

Бит, будучи наименьшей возможной частью информации в компьютере, является довольно маленькой единицей. Поэтому на практике чаще всего используется другая единица, которая называется 1 байт =8 бит.

Единицы, производные от бита

С точки зрения компьютерного устройства, байт примечателен тем, что это минимальная адресуемая информация в компьютере, иными словами, невозможно прочитать часть байта из памяти. В современных компьютерах все устройства памяти имеют байтовую структуру, и внешние устройства также обмениваются информационными байтами или кратными ей. В результате все типы данных (числа, символы и т. д.) представлены в компьютере кратными байту.

Запись. Даже логические переменные, для каждой из которых, казалось бы, достаточно 1 бита, обычно занимают полный байт в ОЗУ, или иногда ради единообразия даже несколько байтов, например LongBool в Pascal.

Чтобы получить шкалу для измерения объемов информации в широком диапазоне от байтов с использованием стандартных префиксов. Формируется целая система больших производных единиц:

В отличие от общепринятой системы производных единиц, широко используемой, например, в физике, при преобразовании используется коэффициент 1024, а не 1000. Причиной является двоичный характер представления информации в компьютере: 1024 = 210, и поэтому он лучше подходит для измерения двоичной информации.

Научившись измерять объем информации, вы сможете узнать, как быстро она передается. Значение, которое равно количеству информации, передаваемой за единицу времени, обычно называется скоростью передачи информации. Очевидно, что если объем информации I передается по каналу связи за время t, то скорость передачи рассчитывается как отношение I/t.

К. Шеннон в созданной им теории информации доказал, что всегда можно добиться передачи пропускной способности линии, и путь к этому заключается в повышении эффективности кодирования. Более того, даже если в канале присутствует шум любого уровня, вы всегда можете закодировать сообщение таким образом, чтобы не было потери информации.

Заключение

Связь между вероятностным и объемным объемом информации неоднозначна. Не каждый текст, написанный в двоичных символах, позволяет измерять объем информации в вероятностном кибернетическом смысле, но он, безусловно, допускает его в объеме. Кроме того, если определенное сообщение позволяет измерить количество информации в обоих смыслах, то это количество не обязательно совпадает, в то время как кибернетический объем информации не может быть больше, чем объем.

В прикладной информатике почти всегда объем информации понимается в широком смысле. Неважно, насколько важно измерение информации, невозможно свести к нему все проблемы, связанные с этим понятием. При анализе информации социального происхождения на первый план могут выходить такие свойства, как правдивость, своевременность, ценность, полнота и т. д.

Их нельзя оценить с точки зрения «уменьшения неопределенности» или количества символов. Обращение к качественной стороне информации породило различные подходы к ее оценке. Аксиологический подход стремится исходить из ценности, практической значимости информации, то есть качественных характеристик, значимых в социальной системе. В семантическом подходе информация рассматривается как с точки зрения формы, так и содержания.

Более того, информация связана с тезаурусом, то есть полнотой систематического набора данных по предмету информации. Очевидно, что эти подходы не исключают количественного анализа, но он становится все более сложным и должен основываться на современных методах математической статистики. Возможно, в будущем, исходя из прогресса в кибернетике, информация будет измеряться по-разному.

Присылайте задания в любое время дня и ночи в ➔

Официальный сайт Брильёновой Натальи Валерьевны преподавателя кафедры информатики и электроники Екатеринбургского государственного института.

Все авторские права на размещённые материалы сохранены за правообладателями этих материалов. Любое коммерческое и/или иное использование кроме предварительного ознакомления материалов сайта natalibrilenova.ru запрещено. Публикация и распространение размещённых материалов не преследует за собой коммерческой и/или любой другой выгоды.