Как отмечается погрешность в физике

Физика. Информатика. Портфолио.

Нашёл ошибку!?

Кто здесь?

Сейчас на сайте 57 гостей и нет пользователей

Последние слова

Информатика

Глобус

Статистика

Как определять погрешность измерений (учебник Физика 10)

1. Как определять погрешности измерений.

Выполнение лабораторных работ связано с измерением различных физических величин и последующей обработкой их результатов.

Измерение — нахождение значения физической величины опытным путем с помощью средств измерений.

Прямое измерение — определение значения физической величины непосредственно средствами измерения.

Косвенное измерение — определение значения физической величины по формуле, связывающей ее с другими физическими величинами, определяемыми прямыми измерениями.

Введем следующие обозначения:

Апр — приближенное значение физической величины, т. е. значение, полученное путем прямых или косвенных измерений.

ΔА — абсолютная погрешность измерения физической величины.

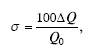

ε — относительная погрешность измерения физической величины, равная:

ΔИА — абсолютная инструментальная погрешность, определяемая конструкцией прибора (погрешность средств измерения; см. табл. 1).

Δ0А — абсолютная погрешность отсчета (получающаяся от недостаточно точного отсчета показаний средств измерения); она равна в большинстве случаев половине цены деления, при измерении времени — цене деления секундомера или часов.

Абсолютные инструментальные погрешности средств измерений

| № | Средства измерения | Предел измерения | Цена деления | Абсолютная инструментальная погрешность |

| 1 | Линейка | |||

| ученическая | до 50 см | 1 мм | ± 1 мм | |

| чертежная | до 50 см | 1 мм | ± 0,2 мм | |

| инструментальная (стальная) | 20 см | 1 мм | ± 0,1 мм | |

| демонстрационная | 100 см | 1 см | ± 0,5 см | |

| 2 | Лента измерительная | 150 см | 0,5 см | ± 0,5 см |

| 3 | Измерительный цилиндр | до 250 мл | 1 мл | ± 1 мл |

| 4 | Штангенциркуль | 150 мм | 0,1 мм | ± 0,05 мм |

| 5 | Микрометр | 25 мм | 0,01 мм | ± 0,005 мм |

| 6 | Динамометр учебный | 4 Н | 0,1 Н | ± 0,05 Н |

| 7 | Весы учебные | 200 г | — | ± 0,01 г |

| 8 | Секундомер | 0-30 мин | 0,2 с | ± 1 с за 30 мин |

| 9 | Барометр-анероид | 720-780 мм рт. ст. | 1 мм рт. ст. | ± 3 мм рт. ст. |

| 10 | Термометр лабораторный | 0-100 0 С | 1 0 С | ± 1 0 С |

| 11 | Амперметр школьный | 2 А | 0,1 А | ± 0,05 А |

| 12 | Вольтметр школьный | 6 В | 0,2 В | ± 0,15 В |

Максимальная абсолютная погрешность прямых измерений складывается из абсолютной инструментальной погрешности и абсолютной погрешности отсчета при отсутствии других погрешностей:

Абсолютную погрешность измерения обычно округляют до одной значащей цифры (ΔА = 0,17 ≈ 0,2); числовое значение результата измерений округляют так, чтобы его последняя цифра оказалась в том же разряде, что и цифра погрешности (А = 10,332 ≈ 10,3).

Результаты повторных измерений физической величины А, проведенных при одних и тех же контролируемых условиях и при использовании достаточно чувствительных и точных (с малыми погрешностями) средств измерения, обычно отличаются друг от друга. В этом случае Апр находят как среднее арифметическое значение всех измерений, а погрешность ΔА (ее называют случайной погрешностью) определяют методами математической статистики.

В школьной лабораторной практике такие средства измерения практически не используются. Поэтому при выполнении лабораторных работ необходимо определять максимальные погрешности измерения физических величин. Для получения результата достаточно одного измерения.

Относительная погрешность косвенных измерений определяется так, как показано в таблице 2.

Формулы для вычисления относительной погрешности косвенных измерений

| № | Формула для физической величины | Формула для относительной погрешности |

| 1 |  |  |

| 2 |  |  |

| 3 |  |  |

| 4 |  |  |

Абсолютная погрешность косвенных измерений определяется по формуле ΔА = Апрε (ε выражается десятичной дробью).

2. О классе точности электроизмерительных приборов.

Для определения абсолютной инструментальной погрешности прибора надо знать его класс точности. Класс точности γпр измерительного прибора показывает, сколько процентов составляет абсолютная инструментальная погрешность ΔиА от всей шкалы прибора (Amax):

Класс точности указывают на шкале прибора или в его паспорте (знак % при этом не пишут). Существуют следующие классы точности электроизмерительных приборов: 0,1; 0,2; 0,5; 1; 1,5; 2,5; 4. Зная класс точности прибора (γпр) и всю его шкалу (Аmах), определяют абсолютную погрешность ΔиА измерения физической величины А этим прибором:

3. Как сравнивать результаты измерений.

1. Записать результаты измерений в виде двойных неравенств:

Относительная погрешность

Погре́шность измере́ния — оценка отклонения величины измеренного значения величины от её истинного значения. Погрешность измерения является характеристикой (мерой) точности измерения.

Поскольку выяснить с абсолютной точностью истинное значение любой величины невозможно, то невозможно и указать величину отклонения измеренного значения от истинного. (Это отклонение принято называть ошибкой измерения. В ряде источников, например, в БСЭ, термины ошибка измерения и погрешность измерения используются как синонимы.) Возможно лишь оценить величину этого отклонения, например, при помощи статистических методов. При этом за истинное значение принимается среднестатистическое значение, полученное при статистической обработке результатов серии измерений. Это полученное значение не является точным, а лишь наиболее вероятным. Поэтому в измерениях необходимо указывать, какова их точность. Для этого вместе с полученным результатом указывается погрешность измерений. Например, запись T=2.8±0.1 c. означает, что истинное значение величины T лежит в интервале от 2.7 с. до 2.9 с. некоторой оговоренной вероятностью (см. доверительный интервал, доверительная вероятность, стандартная ошибка).

В 2006 году на международном уровне был принят новый документ, диктующий условия проведения измерений и установивший новые правила сличения государственных эталонов. Понятие «погрешность» стало устаревать, вместо него было введено понятие «неопределенность измерений».

Содержание

Определение погрешности

В зависимости от характеристик измеряемой величины для определения погрешности измерений используют различные методы.

Классификация погрешностей

По форме представления

где Xtrue — истинное значение, а Xmeas — измеренное значение, должно выполняться с некоторой вероятностью близкой к 1. Если случайная величина Xmeas распределена по нормальному закону, то, обычно, за абсолютную погрешность принимают её среднеквадратичное отклонение. Абсолютная погрешность измеряется в тех же единицах измерения, что и сама величина.

Относительная погрешность является безразмерной величиной, либо измеряется в процентах.

— если шкала прибора односторонняя, т.е. нижний предел измерений равен нулю, то Xn определяется равным верхнему пределу измерений;

— если шкала прибора двухсторонняя, то нормирующее значение равно ширине диапазона измерений прибора.

По причине возникновения

В технике применяют приборы для измерения лишь с определенной заранее заданной точностью – основной погрешностью, допускаемой нормали в нормальных условиях эксплуатации для данного прибора.

Если прибор работает в условиях, отличных от нормальных, то возникает дополнительная погрешность, увеличивающая общую погрешность прибора. К дополнительным погрешностям относятся: температурная, вызванная отклонением температуры окружающей среды от нормальной, установочная, обусловленная отклонением положения прибора от нормального рабочего положения, и т.п. За нормальную температуру окружающего воздуха принимают 20°С, за нормальное атмосферное давление 01,325 кПа.

§ 5. Точность и погрешность измерений

Всякое измерение может быть выполнено с большей или меньшей точностью.

В качестве примера рассмотрим измерение длины ручки демонстрационным метром с сантиметровыми делениями (рис. 14).

Вначале определим цену деления линейки. Она будет равна 1 см.

Если верхний конец ручки совместить с нулевым штрихом, то нижний будет находиться между 11 и 12 штрихами, но ближе к 11.

Какое же из этих двух значений следует принять за длину ручки? Очевидно, то, которое ближе к истинному значению, т. е. 11 см.

Считая, что длина ручки 11 см, мы допустили неточность, так как ручка чуть длиннее 11 см.

В физике допускаемую при измерении неточность называют погрешностью измерений.

Погрешность измерения не может быть больше цены деления шкалы измерительного прибора.

В нашем случае погрешность измерения ручки не превышает 1 см. Если такая точность измерений нас не удовлетворяет, то можно произвести измерения с большей точностью. Но тогда придётся взять масштабную линейку с миллиметровыми делениями, т. е. с ценой деления 1 мм.

В этом случае длина ручки окажется равной 11,2 см.

Из этого примера видно, что точность измерений зависит от цены деления шкалы прибора.

Чем меньше цена деления, тем больше точность измерения.

Точность измерения зависит также от правильного применения измерительного прибора, расположения глаза при отсчёте по прибору.

Вследствие несовершенства измерительных приборов и наших органов чувств при любом измерении получаются лишь приближённые значения, несколько большие или меньшие истинного значения измеряемой величины.

Во время выполнения лабораторных работ или просто измерений следует считать, что погрешность измерений равна половине цены деления шкалы измерительного прибора.

Измерим длину карандаша. Нулевую отметку линейки совместим с одним концом карандаша, а другой её конец окажется вблизи 14 см. Цена деления линейки 1 мм, тогда погрешность измерения будет равна 0,5 мм или 0,05 см.

Следовательно, длину карандаша можно записать в виде

где I — длина карандаша.

Истинное значение длины карандаша находится в интервале от 13,95 см до 14,05 см.

При записи величин, с учётом погрешности, следует пользоваться формулой

где А — измеряемая величина, а — результат измерений, Δа — погрешность измерений (Δ — греч. буква «дельта»).

Вопросы

1. Как понимать выражение «измерить длину с точностью до 1 мм»?

2. Можно ли линейкой, имеющей сантиметровые деления, измерить длину с точностью до 1 мм?

3. Какова связь точности измерений с ценой деления шкалы прибора?

4. Какой формулой необходимо пользоваться при записи физических величин с учётом погрешности?

Задание

1. Измерьте линейкой с миллиметровыми делениями длину и ширину вашего учебника. Запишите результаты с учётом погрешности измерения.

2. Пользуясь рисунком 11, б, определите погрешность измерения термометра.

3. Измерьте линейкой с миллиметровыми делениями длину и высоту картины Л. да Винчи (рис. 15). Запишите результаты измерений с учётом погрешности. Используя Интернет, найдите название картины, её истинный размер и определите масштаб, в котором картина представлена в учебнике.

Что такое погрешность в физике?

Как найти погрешность измерения в физике?

Как определить погрешность?

Чтобы узнать относительную погрешность, разделите абсолютную погрешность на измеренное значение, затем умножьте на 100, чтобы выразить результат в процентах. Например: (6 см ± 0,2 см) = (0,2 / 6) x 100 — добавив знак процента, получаем 3,3 %.

Что такое погрешность и как ее определить?

Погрешность — это отклонение результата данных от измеряемой величины. Термин используется в физике, экономике и маркетинге. Погрешность измерений — это сумма всех погрешностей, у каждой из которых имеется причина. Оценка специалиста считается неточной, если эта величина не указана.

Что такое погрешность простыми словами?

Погрешности измерения – отклонение результатов измерения от «истинного» значения измеряемой величины, возникающее из-за несовершенства результатов измерений. Выразить погрешность измерения можно и в абсолютных и в относительных величинах.

Как учитывается погрешность измерительного прибора?

Как определить абсолютную погрешность измерения массы?

Абсолютной погрешностью числа называют разницу между этим числом и его точным значением. Рассмотрим пример: в школе учится 374 ученика. Если округлить это число до 400, то абсолютная погрешность измерения равна 400-374=26. Для подсчета абсолютной погрешности необходимо из большего числа вычитать меньшее.

Как определить погрешность измерения линейки?

Погрешность измерений равна половине цены деления шкалы измерительного прибора. При записи величин (с учётом погрешности) следует пользоваться формулой: A=a±Δa, где \(A\) — измеряемая величина, \(a\) — результат измерений, Δa — погрешность измерений (Δ — греческая буква «дельта»).

Как определить абсолютную погрешность измерения?

Как определить погрешность измерений прибора?

Как определить погрешность измерения формула?

Как определить методическую погрешность?

Значение методической погрешности результата измерения мощности в абсолютном Δ и относительном 8 видах в данном случае можно оценить следующим образом: Δ = P – Pд=I 2 A RA; δ = Δ/ Pд ·100.

Как определить погрешность динамометра?

Динамометр, как и всякий прибор, имеет погрешность. В паспорте школьного динамометра, рассчитанного на измерение сил в пределах от 0 до 5 Н, говорится, что погрешность прибора Δпр = 0,05 Н в любом месте шкалы.

Что значит абсолютная погрешность?

Абсолютная погрешность измерения – это погрешность средства измерений, выраженная в единицах измеряемой физической величины, характеризующая абсолютное отклонение измеряемой величины от действительного значения физической величины: ∆X = X – XД.

Что называется приведенной погрешностью?

Приведенная погрешность средства измерений (англ. reducial error of a measuring instrument) – относительная погрешность, выраженная отношением абсолютной погрешности средства измерений к условно принятому значению величины, постоянному во всем диапазоне измерений или в части диапазона.

Что называется абсолютной погрешностью?

Абсолютная погрешность – это разница между измеренной датчиком величиной Хизм и действительным значением Хд этой величины.

Виды погрешностей. Погрешность измерений. Виды погрешностей

Погрешность измерений. Виды погрешностей.

В практике использования измерений очень важным показателем становится их точность, которая представляет собой ту степень близости итогов измерения к некоторому действительному значению, которая используется для качественного сравнения измерительных операций. А в качестве количественной оценки, как правило, используется погрешность измерений.

Разница между результатом измерения и истинным значением измеряемой величины называется погрешностью измерения.

Причем чем погрешность меньше, тем считается выше точность.

Согласно закону теории погрешностей, если необходимо повысить точность результата (при исключенной систематической погрешности) в 2 раза, то число измерений необходимо увеличить в 4 раза; если требуется увеличить точность в 3 раза, то число измерений увеличивают в 9 раз и т. д.

Процесс оценки погрешности измерений считается одним из важнейших мероприятий в вопросе обеспечения единства измерений. Естественно, что факторов, оказывающих влияние на точность измерения, существует огромное множество. Следовательно, любая классификация погрешностей измерения достаточно условна, поскольку нередко в зависимости от условий измерительного процесса погрешности могут проявляться в различных группах.

Выделяют следующие виды погрешностей:

1) абсолютная погрешность;

2) относительна погрешность;

3) приведенная погрешность;

4) основная погрешность;

5) дополнительная погрешность;

6) систематическая погрешность;

7) случайная погрешность;

8) инструментальная погрешность;

9) методическая погрешность;

10) личная погрешность;

11) статическая погрешность;

12) динамическая погрешность.

Абсолютная погрешность – это значение, вычисляемое как разность между значением величины, полученным в процессе измерений, и настоящим (действительным) значением данной величины.

Абсолютная погрешность вычисляется по следующей формуле:

где AQn – абсолютная погрешность;

Qn – значение некой величины, полученное в процессе измерения;

Q0 – значение той же самой величины, принятое за базу сравнения (настоящее значение).

Относительная погрешность – это число, отражающее степень точности измерения.

Относительная погрешность вычисляется по следующей формуле:

где ΔQ – абсолютная погрешность;

Q0 – настоящее (действительное) значение измеряемой величины.

Относительная погрешность выражается в процентах.

Приведенная погрешность – это значение, вычисляемое как отношение значения абсолютной погрешности к нормирующему значению.

Инструментальная погрешность – это погрешность, возникающая из—за допущенных в процессе изготовления функциональных частей средств измерения ошибок.

Методическая погрешность – это погрешность, возникающая по следующим причинам:

1) неточность построения модели физического процесса, на котором базируется средство измерения;

2) неверное применение средств измерений.

Субъективная погрешность – это погрешность возникающая из-за низкой степени квалификации оператора средства измерений, а также из-за погрешности зрительных органов человека, т. е. причиной возникновения субъективной погрешности является человеческий фактор.

Погрешности по взаимодействию изменений во времени и входной величины делятся на статические и динамические погрешности.

Неточность градуировки, конструктивные несовершенства, изменения характеристик прибора в процессе эксплуатации и т. д. являются причинами основных погрешностей инструмента измерения.

Дополнительные погрешности, связанные с отклонением условий, в которых работает прибор, от нормальных, отличают от инструментальных (ГОСТ 8.009-84), т. к. они связаны скорее с внешними условиями, чем с самим прибором.

Систематическая погрешность – это составляющая погрешности измерения, остающаяся постоянной или закономерно изменяющаяся при повторных измерениях одной и той же величины. Причинами появления систематической погрешности могут являться неисправности средств измерений, несовершенство метода измерений, неправильная установка измерительных приборов, отступление от нормальных условий их работы, особенности самого оператора.

Статическая погрешность – это погрешность, которая возникает в процессе измерения постоянной (не изменяющейся во времени) величины.

Динамическая погрешность – это погрешность, численное значение которой вычисляется как разность между погрешностью, возникающей при измерении непостоянной (переменной во времени) величины, и статической погрешностью (погрешностью значения измеряемой величины в определенный момент времени).

Случайная погрешность – это составная часть погрешности результата измерения, изменяющаяся случайно, незакономерно при проведении повторных измерений одной и той же величины. Появление случайной погрешности нельзя предвидеть и предугадать. Случайную погрешность невозможно полностью устранить, она всегда в некоторой степени искажает конечные результаты измерений. Но можно сделать результат измерения более точным за счет проведения повторных измерений.

Причиной случайной погрешности может стать, например, случайное изменение внешних факторов, воздействующих на процесс измерения. Случайная погрешность при проведении многократных измерений с достаточно большой степенью точности приводит к рассеянию результатов.